AIで合成されたエロ動画・画像に、自分の顔が知らないうちに使われる! 韓国では社会問題に! 日本でもひそかに蔓延中!?

AIで合成されたエロ動画・画像に、自分の顔が知らないうちに使われる! 韓国では社会問題に! 日本でもひそかに蔓延中!?

AI技術を使って人物の動画や音声を別の人物に合成、本人が話したり、動いたりしているように見えるニセ映像などを「ディープフェイク」という。韓国ではこの技術が悪用され、性被害が続出! 国が規制に乗り出す事態になった。

日本でも徐々に広がりつつあるディープフェイクポルノの実態は? "職人"にいろいろ聞いた!

■「ディープフェイク」が特殊詐欺にも使われる

前澤友作氏や堀江貴文氏ら著名人の名前を利用して投資を呼びかける偽広告がSNS上で話題になったが、お隣の韓国では、その上をいく大胆な手口が登場している。

「収益金の一部が寄付されていることに感謝しています」

スーツにネクタイを着けた人気俳優のチョ・インソンは、いかにも誠実そうにカメラに向かって呼びかける。これはYouTubeなどに投稿された投資会社の広告だ。

しかし、動画に映し出された人物はチョ本人ではない。これは、生成AIを利用して複数の動画や画像、音声などを合成する技術「ディープフェイク」によって制作されたフェイク動画だ。

この技術を使うことによって、人物が映っている画像や動画の顔などを差し替えることができる。中でも動画に関しては素材となった顔の表情などを生成AIが学習し、その練度によっては本物が動き、話していると見まがうほど"自然な"動画になる。

韓国在住のジャーナリスト、ノ・ミンハ氏は言う。

「動画が出回ったのは2023年末です。動画には女優のソン・ヘギョも登場しますが、これももちろんディープフェイクによるもの。動画の内容を信じ、1億6000万ウォン(約1800万円)をだまし取られた人もいるそうです」

ディープフェイクで芸能人を広告に利用したケースは、ほかにもある。

「8月頃、ガールズグループBLACKPINKのリサがオンラインカジノを紹介する動画がTikTokなどで拡散されました。韓国国外にサーバーを置く違法サイトの会員募集のための釣り広告ですが、あまりに本人そっくりなので、だまされた人もいるようです」(ノ氏、以下同)

(左)「BLACKPINK」のメンバー、リサの顔を無断で使用したフェイク動画。(右)本物のリサ

(左)「BLACKPINK」のメンバー、リサの顔を無断で使用したフェイク動画。(右)本物のリサ

韓国では音声をAIで生成した「ディープボイス」を利用した特殊詐欺も横行している。

「犯人はまずターゲットに電話をかけ、相手の『もしもし』の声を録音します。そして、その音声をAIが学習し、本人そっくりの声を生成、ターゲットの親族や知人に電話で『お金が必要だから送金して』などと言う。そうして本人を装い、金をだまし取るのです」

こうした事件が多発していることを受け、知らない番号からの電話に出る際に「もしもし」を言わない人が増えているという。

さらに深刻なのは、性的な画像や動画に加工する「ディープフェイクポルノ」だ。TWICEなどのアーティストが被害に遭っているほか、インスタグラムなどで人気のインフルエンサーの顔とポルノ女優の体を合成した動画や画像が、SNS上に出回った。

それらを流通させているのは、違法な闇業者だ。彼らはSNSにサンプル動画を投稿、購入を希望する客から仮想通貨やギフトカードの番号を受け取ると、希望どおりの画像や動画を制作し、高い秘匿性で知られるメッセージアプリ『テレグラム』などを通じて納品するという。

「先日、釜山でディープフェイクポルノの動画を制作していた20歳の男が逮捕されました。彼はテレグラム上に『一般会員』『VIP』などランクごとにチャンネルを開設。入場料として2万~10万ウォン(約2000~1万1000円)を徴収し、動画を提供していたそうです。警察は、視聴していた会員が2800人に上ることを確認しています」

■大統領が撲滅を宣言

ディープフェイクポルノは、韓国の青少年の間にも広がっている。手軽に利用できるアプリなどを使って同級生や教師の顔をアダルト動画に合成する事件が多発しているのだ。

「9月に、仁川(インチョン)市の男子高校生が女性教師の顔と別人の裸を合成したディープフェイク動画をSNSに投稿し、逮捕されました。動機を聞かれた彼は『きれいな女性だったから』とだけ答えたそうです」

この事件について、ソウル在住の中学生Aさんは「学生は自由にAVを見ることができないので、ディープフェイクで好きな人の顔を合成して、AV代わりに鑑賞しているんだよ」とあっけらかんと言う。

日本の文部科学省にあたる韓国教育部によると、今年1月から9月までに全国の中学・高校で報告されたディープフェイクポルノによる被害件数は504件に上り、833人が被害に遭った。内訳は生徒が799人で、教師が31人、職員が3人だったという。

「こうした状況から、インスタグラムのアカウントを非公開にしたり、閉鎖したりする女性が増えています」(ノ氏、以下同)

8月30日、韓国・ソウルで行なわれたディープフェイクポルノ問題について政府に調査を促す抗議デモの様子

8月30日、韓国・ソウルで行なわれたディープフェイクポルノ問題について政府に調査を促す抗議デモの様子

今や誰でも気軽にディープフェイク画像や動画を作成できるようになった。

「メッセージアプリ『Discord(ディスコード)』には顔交換プラグイン『InsightFace(インサイトフェイス)』が実装されていて、広く使われていました。仁川の男子高生もこの機能を使っていたとみられます。

ほかにも『Reface(リフェイス)』や『Mivo(ミボ)』など、ディープフェイク関連の手軽なアプリがいくつかあり、若い人たちに広まっていました。ただ、今はほとんどのアプリが利用を制限されたり、ダウンロードができなくなったりしています」

韓国政府も対策に乗り出した。尹錫悦(ユン・ソンニョル)大統領は8月、「ディープフェイクは明白な犯罪であり、誰もがこうしたデジタル性犯罪の被害者になりえる」として徹底的な捜査を指示。9月26日には、「ディープフェイク性犯罪防止法」が国会で可決された。

「警察は8月末から9月25日までの間に、ディープフェイクポルノに関わった容疑で387人を逮捕しましたが、今後、防止法が施行されると動画を所持しただけでも逮捕され、3年以下の懲役が科せられます。また、警察は91億ウォン(約10億円)を投じてディープフェイク検出技術を開発中です」

■業者が語る"マスク"作り

一方、日本はというと「韓国のように社会問題になるほど深刻化はしていませんが、学生など一般人がディープフェイクポルノの被害に遭うケースが増えてきている」(全国紙社会部記者)という。

実際、ディープフェイクポルノへの関心は広がりつつあるようだ。Xにはディープフェイク技術について発信したり、その技術を使った"顔替え代行"をうたったりする業者のアカウントがいくつもある。

その中のひとり、中国を拠点に活動する日本人ディープフェイク職人の「おすしスキー」氏に話を聞いた。同氏によると、ディープフェイクという技術が飛躍的に向上したのは2018年頃だ。その前年に『FaceSwap(フェイススワップ)』という、大量の素材を学習し、精巧なディープフェイク動画をつくることが可能になるツールが登場したことがきっかけだった。

「もともとは仮想通貨のマイニングをしていましたが、相場が低迷したのをきっかけに、それに使用していた数十台のハイスペックのPCを生かすためにこの業界に参入しました。日本よりも安い電気代や、最先端のテクノロジーを利用できる技術面から、中国にはメリットがあります」

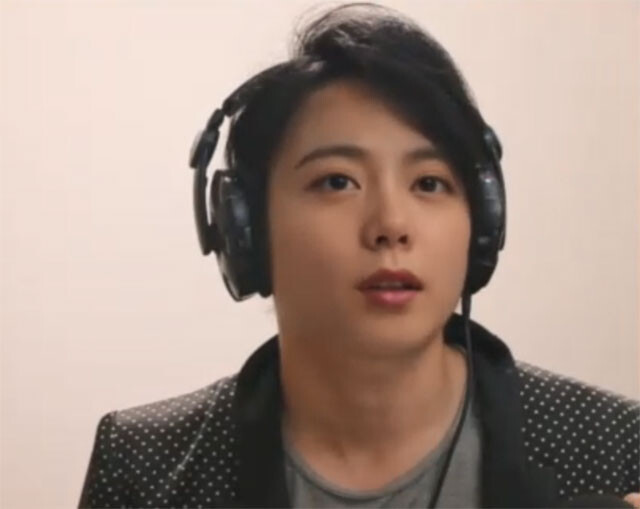

リモート取材の際の、カメラに映ったおすしスキー氏の姿。ディープフェイクを使った偽の顔であるが、その話している様子には多少の不自然さがあるものの、かなり"本物"に見える

リモート取材の際の、カメラに映ったおすしスキー氏の姿。ディープフェイクを使った偽の顔であるが、その話している様子には多少の不自然さがあるものの、かなり"本物"に見える

日本人と中国人をメインに十数人でチームを組織した。

クオリティの高いディープフェイク動画を制作するには、AIによる大量の機械学習が欠かせない。そのため、動画1本を作るのにも、毎日すべてのハイスペックPCを1ヵ月以上稼働させる必要があり、コストがかかる。受注額は120万円以上になることがザラだとか。

「まずは、クライアントから提供された画像素材をもとに差し替えるための顔の"マスク"を制作する。そして、そのマスクを動画の顔の動きに合わせて合成していきます。マスクさえ完成すれば、いろいろな動画に合成することが可能です」

機械学習には、素材のバリエーションが重要だという。

「顔の表情や角度を網羅できるだけの画像のパターンが必要です。例えば『笑顔』が口角が少し上がる程度の1段階目から、思いっきり爆笑している10段階目まであるとして、2段階目以降の顔の画像がなかったらマスクは1段階目の笑顔で固定されてしまうので、合成しても元の動画の顔と表情が合わず、違和感が生じます。

また、横向きの画像の素材が少なければ、動画の顔が横を向いたときに映像が崩れやすくなる」

世の中に存在しない顔を作ることも可能だが、あらゆる表情や角度を網羅するには、やはり時間と手間がかかるという。精巧なマスクであれば、映像とのリアルタイムな合成が可能なので、ライブ配信も別人の顔で行なうことができる。

この取材はオンラインで行なったが、おすしスキー氏の顔は、存在しない架空の顔にすげ替えられていた。声もディープボイスで変えられていたが、言われるまで気づかないほどリアルだった。

■「今晩のおかず」から「謎の研究開発」まで

おすしスキー氏の顧客は映像制作会社から広告代理店、ユーチューバーやティックトッカーなど多岐にわたるが、アダルト関連の依頼も少なくないという。『FC2』などのサイトへの投稿を目的とした同人AVサークルからの依頼が多いが、中には法に触れそうな動画の制作を依頼してくるクライアントもいるという。

「"芸能人の激似"シリーズを販売したいから、AVの動画を芸能人の顔に差し替えてほしい、という依頼がありました。適切な素材を提供してくれずコミュニケーションコストがかかったこともありますし、激似と予防線を張っているとはいえ、本人の画像を使うのですから、肖像権の侵害になる可能性もある。結局、その依頼はお断りしました」

企業や組織だけでなく、一般の個人からの依頼もある。

「アダルト動画をアイドルグループの女性の顔に差し替えてほしいという依頼がありまして、これまでにアイドルのDVDから切り出した画像をもとに、4人のマスクを制作しました。それをもとに、20分程度の動画を毎月1本制作して提供しています。その方は、この2年間で、600万円以上は使っているでしょう」

ほかに、こんな変わった依頼も。

「それなりの規模の企業の幹部から一般女性の画像が送られてきて、研究開発の名目でアダルト動画の顔を差し替えてほしいという依頼がありました。作り方をグイグイ聞いてくるので、何回かレクチャーもしましたね。支払いは会社名義でしたが、なんの研究に使われているのかは謎です」

動画配信プラットフォームの運営企業も動き出しているようだ。

「ディープフェイクのプログラムを組み込みたいという相談がプラットフォーマーからありました。それを配信者にオプションとして提供し、身バレせずにアダルトライブチャットをできるようにしたいそうです。

億単位の開発費がかかるという話をしていますが、サンプルを送って進めているところです」

Xで検索してみるとディープフェイクを使った動画制作を請け負う業者のアカウントがいくつか見つかる

Xで検索してみるとディープフェイクを使った動画制作を請け負う業者のアカウントがいくつか見つかる

これが実現すれば、一般人でも簡単に身バレを気にすることなく、生身を使ったアダルト系のライブ配信ができるようになる、というわけだ。

「動画で本人が言っていないことを言わせる口パクも、技術的にはできるフェーズに入っているので、いずれ配信者が実際にカメラの前に立つ必要がなくなるのではないかと思っています。動画を制作する工程も自動化されるでしょう。

自分の考え方をデータ化し、テーマを指定するだけで本人が発言しそうな台本を作って読み上げてくれる。本人が動かなくても、動画を1日に何百本も投稿できるようになるのです」

ディープフェイクの技術は着々と進化しているが、それは本物と見分けがつかないディープフェイクポルノが広がる危険性も高まっていくということだろう。韓国のようなひどい事態にならないといいが......。