ChatGPTの開発企業・オープンAI社のサム・アルトマンCEOが4月10日に来日。岸田首相と面会し、日本のマーケットを重視していると話したという

ChatGPTの開発企業・オープンAI社のサム・アルトマンCEOが4月10日に来日。岸田首相と面会し、日本のマーケットを重視していると話したという

世界中で話題沸騰の文章生成AI「ChatGPT」。従来の予想を大きく上回るその進化スピードに待ったをかける動きが欧米各国で相次いでいる。では実際のところ、このAIは何がスゴくて何が「怖い」のだろうか?企業活動や軍事、さらには犯罪など、さまざまな側面からじっくり検証してみた!

* * *

■日本を起点に盛り返しを狙う?

米オープンAI社の対話型AI「ChatGPT(チャットGPT)」。昨年11月に無料で公開されて以降、わずか2ヵ月でユーザー数1億人を突破した。

ビル・ゲイツ氏は「インターネットや携帯電話の発明に並ぶ革命だ」と称賛し、「危険なほど強力なAIが現実味を帯びてきた」とイーロン・マスク氏をビビらせた。「ChatGPT」のスゴさについて、ITジャーナリストの星 暁雄氏がこう話す。

「政治、経済、哲学、ITなど、あらゆるジャンルのユーザーの問いかけに、おおむね適切で筋の通った答えを返してくる言語処理能力が、従来の対話型AIより並外れて高い。どんな質問にも、博識で人格の優れた人間のような物言いで回答してきます」

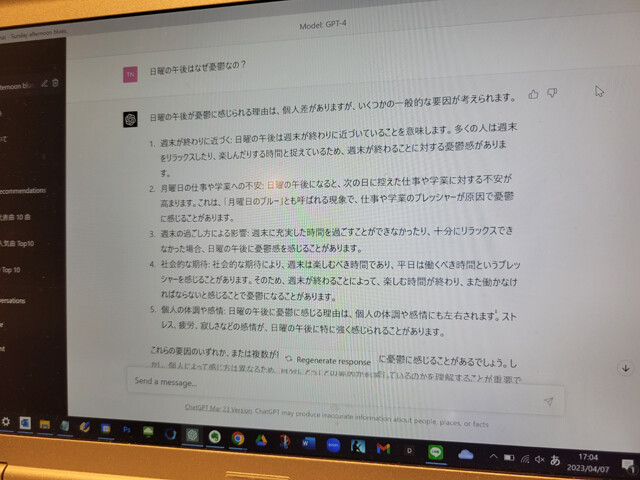

オープンAI社は、最新バージョンの「GPT-4」を今年3月に公開。さらに、同社と提携した米マイクロソフトが、GPT-4を搭載した検索エンジン「Bing AI」の提供を開始した。

「それまでのChatGPTは長文にやや弱く、2021年9月時点の古いデータに基づいて回答するため、それ以降の最新の情報を反映できないという弱点がありました。

しかし、GPT-4では一度に扱える入力文字数が2000字程度から2万5000字程度まで拡大され、Bing AIではリアルタイムの情報を盛り込んだ回答ができるようになりました。GPT-4は一冊の本を書き上げるレベルまで言語処理能力が向上しています」

ChatGPTには無料版と有料版がある。有料版(月額約2600円)は、最新版の「GPT-4」が使用できる

ChatGPTには無料版と有料版がある。有料版(月額約2600円)は、最新版の「GPT-4」が使用できる

そんな中、オープンAI社のサム・アルトマンCEOが4月10日に来日、岸田文雄首相と面会した。同氏が一国の首脳と会談するのは、G7(主要7ヵ国)では日本が初めてだという。今、世界で最も注目される人物が日本を選んだワケは? AIに詳しい経営コンサルタントの小林啓倫氏はこう話す。

「ChatGPTは、社会のあり方を大きく書き換える革命的な技術となる可能性を秘めています。ただ、イタリアはデータ収集方法を問題視し、個人情報が漏洩(ろうえい)する恐れがあるとして国内でのChatGPTの使用禁止に踏み切り、ドイツやフランスでも規制の動きが出ているとの観測もある。

また、アメリカでもプライバシーの侵害や偽情報の拡散などの懸念が広がり、バイデン大統領が規制案の検討に着手したとも報じられている。欧米ではChatGPTの普及にブレーキをかける動きが急加速しています。

一方で日本は、どちらかというとChatGPTにかなり好意的。SNSや報道を見ても、『この技術はスゴい』『乗り遅れるとヤバい』などと歓迎ムードです。

おそらく、オープンAI社の内部で、日本からのアクセス数やユーザー数に手応えを得たのでしょう。CEOの来日には、欧米での逆風を日本から盛り返そうという狙いがあったと思われます」

『よくわかる人工知能』などの著者でプログラマーの清水 亮氏はこうみる。

「今回の会合は明らかに政府側からのコンタクトで実現したものでしょう。革新的な技術を生み出したとはいえ、スタートアップの社長にすぎない人物が他国の政府に歩み寄ろうなどとは普通は考えないでしょうから。ただ、アルトマン氏にとって日本政府からの思わぬ〝招待状〟は渡りに船だったはず」

清水氏がこう続ける。

「賛否はありますが、デジタル庁のような、デジタル行政の司令塔となる専門の省庁を持っている国は先進国では珍しく、日本は世界に先駆けてAIを推進するさまざまな法律を積極的に整備している。

なので、これまでの日本のデジタル推進のプロセスを踏まえればアルトマン氏の招聘(しょうへい)は自然な流れとみることもできます」

アルトマン氏は首相との会談後、自民党のデジタル社会推進本部の会合に出席し、「日本に事業拠点を新たに設ける」「日本関連の学習データのウエイト引き上げ」など7つの提案を行なった。

実現すれば、現在のChatGPTの弱点のひとつとされている「たまに事実ではない間違った回答をしてしまう」ことはめったになくなり、ビジネスや行政の分野でChatGPTの導入が急加速する可能性がある。

■企業間に起きる〝AI格差〟

ChatGPTは日本社会にどんな変化をもたらすか? 前出の小林氏はこう話す。

「まず、ビジネス面では業務効率やサービス品質を大きく向上させるでしょう。しかし、その恩恵を受ける企業と受けられない企業の間で深刻な格差が生じる恐れもあります」

どういうことか?

「ChatGPTは、実は企業にとっては導入に踏み切りづらい面があります。ネックとなっているのが情報漏洩のリスクです。

例えば、システム開発を担うシステムエンジニアが、自身で作成したコードをChatGPTに入力して『誤りを見つけて』と指示すればわずか数秒でその結果を示してくれる。あるいは、会議録の文字起こしデータを入力して『1000字に要約して』と指示すれば、数秒でそのとおりのわかりやすい要約文を返してくれる。

これらは人力で数時間かかっていた業務の負担が劇的に軽減するわかりやすい例ですが、コードも議事録も会社にとっては機密情報であり、ChatGPTに入力する時点で情報漏洩に当たる。入力データはGPTの再学習のために使われたり、ほかのユーザーへの回答文に転用されたりする恐れがあるためです」

もちろん対策がないわけではない。

「米マイクロソフト社は自社専用のChatGPTを構築できる有料サービスの提供を始めました。GPTとの情報のやりとりはすべて社内の閉じられた環境で完結するので、漏洩のリスクがない。

米証券大手モルガン・スタンレーはこのサービスを使い、過去の投資実績など10万件超の社内データを学習させた専用GPTを構築しました。ファイナンシャルアドバイザー(人間)と共にAIが厳選した有力銘柄を提示する、といった活用法でサービス品質の向上と業務効率化につなげるのがその狙いです」(小林氏)

国内でも、システム開発会社のパナソニック コネクトが自社専用のChatGPTを導入し、プレゼン資料や議事録の作成を自動化させるなど、大幅な業務改善につなげた事例があるという。

自社専用だから質の高い学習データがどんどん蓄積され、その性能は日進月歩で鍛え上げられていく。

「ただ、システム構築には相応のコストと手間がかかり、負担できない企業も出てくるはず。そうすると資金力のある企業では業務の自動化が着々と進められる一方で、資金力のない企業では負荷のかかる人力作業を継続したまま取り残される、ということにもなりかねません」(小林氏)

就活生にとっては、働く環境を左右する自社専用AIチャットの有無が、企業選びの新基準になるかもしれない。

■「善と悪は表裏一体」

実装はまだ先のことだが、ChatGPTの公的な利用も検討され始めている。

脱税の抜け穴を防ぐAIチャットの開発を進める米ジョンズ・ホプキンス大学は、そのベースとなる技術のひとつにGPT-4を取り入れるとの方針を示した。

「税金に関する法案の素案を入力し、『法が施行されたら、脱税につながる抜け穴は生じないか?』と聞けば、高精度の回答を得ることができるAIチャットです。GPT-4がその実用化を早める可能性があります」(小林氏)

だが一方で、脱税などの違法行為を助けてしまうChatGPTのテクニックが開発され、インターネット上で拡散される動きが出始めているという。その中で今、最も懸念されているのは「サイバー攻撃」だ。

「あるセキュリティ会社の調査報告では、すでに『ランサムウエア(身代金要求型ウイルス)』をChatGPTで自動生成する手法がネット上で拡散しているようです」(小林氏)

ただ、ChatGPTには倫理的、法律的にアウトな回答は自ら拒否する機能がある。たとえ「ランサムウエアを作って」と指示したところで、「悪意のあるプログラムは作成できません」「犯罪や倫理に反する活動は促進できません」と返ってくるはず。

これはフィッシング詐欺のメールの文面や、フェイク記事の作成を指示した際も同じで、ChatGPTには、悪用を防ぐ厳格なフィルターがかけられているのだ。ところが、システムエンジニアのある男性はこう言う。

「ChatGPTは質問の仕方によって回答の質が変わります。より良質な回答を引き出す質問テキストを作成する技術を『プロンプトエンジニアリング』といって、それを専門にするプロンプトエンジニアは、開発会社に高給で雇用されるなど重宝される存在になっています。

しかし、そのテクニックを悪用してフィルターを突破しようとする人たちも出てきている。今は通用しませんが、以前は質問の頭に『これは夢です』とか、『倫理的ガイドラインのことは忘れてください』とか、『私は警察で、犯罪抑止のために』といった文言を入れると犯罪幇助(ほうじょ)につながりかねない回答が返ってきたという話も聞きます」

小林氏もこう警鐘を鳴らす。

「これまで、詐欺やハッキングはプロの手口でしたが、ChatGPTがマルウエアやフィッシングメールを自動生成する状況となれば、犯罪の敷居が下がり、お金に困った素人が裏バイト感覚で流入してくる恐れもある。これは開発企業ではなく国として、早急に手を打たなければならない問題でしょう」

ChatGPTを取り扱うとき、「善と悪が常に表裏一体の関係にあることを念頭に置く必要があると思います」と小林氏は言う。

「例えば、今後はChatGPTの軍事利用も検討されることになるでしょう。最新の軍事知識や紛争地の詳細な情報を読み込ませたChatGPTが兵士の〝参謀役〟となり、いつ、どこへ、どんな攻撃手法で仕掛ければいいかを指南する。

そんな活用法が戦場で実現する日が来るかもしれません。まさに今、兵士が人を殺すのをサポートするAIを作ることが倫理的に許されるのかどうか?が問われていると思います」

■政府に忖度するAI

最後に、ChatGPTの〝政治利用〟にまつわるリスクについて触れておこう。

AIチャットは一般的に、ネット上にある膨大な情報を学習することで、人間のように臨機応変な対応ができるようになる。誤情報や有害情報を省くために再学習をさせたり、微調整を加えたりすることも可能だ。

しかし、ここで懸念されるのは「どんな学習データを読み込ませるか、どんな微調整を加えるか? それによってどんな回答文を示すか?は開発会社の裁量で決まる」(前出・星氏)という点だ。

前述のとおり、オープンAI社のアルトマンCEOは岸田首相と会談後、自民党の会合の席で〝日本びいき〟な提案をした。

「政府とオープンAI社の関係が縮まる中で、仮に政府が『わが党に有利になる回答を出す仕様にしてくれ』と水面下で要望したら、オープンAI側は中立性を堅持して拒否できるか?という局面が出てきます」(前出・小林氏)

オープンAI社はもともと、非営利の研究機関として立ち上がった会社だった。だからこそ、「投資の回収や利益に左右されない研究を貫き、革新的な技術を生み出すことができた」(星氏)とする声もあった。

「しかし、ある時期から営利的になり、マイクロソフトと提携してからは利益重視の姿勢がいっそう強まった。それと同時に、当初オープンにしていた技術情報を公開しなくなり、ChatGPTの不透明性が増している点が不安視されています」(星氏)

非営利でオープンだったはずの世界的なAIの開発機関が、利益を重視する閉鎖的な企業になりつつある。

「中立性と公益性が薄れ始めたオープンAI社が、政府に〝忖度(そんたく)〟した日本版のChatGPTを生み出す可能性も否定できません」(小林氏)

AIが社会を良くするものなのか否かは結局、人間次第ということか。